DeepSeek V4: чего ожидать от МОДЕЛЬ1, Engram и Sparse FP8

DeepSeek V4 обещает значительный шаг вперед для больших моделей, сочетая возможности работы с длинным контекстом, более дешевое прогнозирование и запоминающееся воспроизведение. Ранние утечки и технические описания указывают на четыре основных достижения - многоуровневый KV-кэш (МОДЕЛЬ 1), разреженное декодирование FP8 со смешанной точностью, модуль памяти Engram для долгосрочного воспроизведения и оптимизированные остатки mHC для ускоренного обучения. Вместе они делают длинные, многофайловые коды и многосессионные агенты гораздо более практичными.

Часть 1. DeepSeek V4: Какие основные моменты?

DeepSeek V4 стремится разблокировать действительно длинноконтекстный ИИ с оконным контекстом в 1 миллион токенов, многоуровневым МОДЕЛЬ 1 KV-кэшем для выгрузки в оперативную память, разреженным декодированием FP8 для ускоренного прогнозирования, долгосрочным слоем памяти Engram и остатками mHC, которые ускоряют обучение и повышают стабильность. Эти изменения нацелены на производительность, масштаб и снижение затрат.

- 1.Контекстное окно на 1 миллион токенов - V4 увеличивает пределы контекста с десятков тысяч до примерно одного миллиона токенов, что позволяет анализировать целые кодовые базы или огромные документы.

- 2.Многоуровневый МОДЕЛЬ 1 KV-кэш - Иерархия хранения размещает самые горячие данные KV на GPU, данные средней частоты KV в оперативной памяти и архивные данные KV на диске, сокращая потребности в памяти GPU и расширяя контекст.

- 3.Разреженное декодирование FP8 (смешанная точность) - Избирательная точность использует FP16 для критических токенов и FP8 для остальных, что дает значительное ускорение при минимальной потере качества.

- 4.Модуль памяти Engram - Долгосрочная память на основе векторов отделяет временный контекст от долговременных воспоминаний (предпочтения, проектные решения, история проекта) для персонализированных, многосессионных агентов.

- 5.Оптимизированные остатки mHC - Изучаемое масштабирование остатков по слоям помогает ускорить сходимость, сгладить обучение и получить умеренное повышение качества.

- 6.Нативная поддержка мультимодальности и оптимизация оборудования - V4 создается с учетом мультимодальных вводов и оптимизируется для ряда аппаратного обеспечения для прогнозирования.

- 7.Экосистема и стратегический контекст - Выпуск рассматривается как часть более широкой гонки ИИ, поднимающей вопросы о управлении, безопасности и международном сотрудничестве.

Часть 2. DeepSeek V4: Что может новая архитектура?

Архитектура DeepSeek V4 переосмысливает прогнозирование и память: МОДЕЛЬ 1 снижает давление на память GPU, выгружая большую часть состояния KV в оперативную память и на диск, разреженный FP8 ускоряет декодирование, используя более низкую точность для некритических токенов, Engram обеспечивает извлекаемую долгосрочную память, а остатки mHC ускоряют обучение и стабилизируют обучение. Вместе они делают длинные, устойчевые агенты доступными в масштабе.

Архитектура МОДЕЛЬ 1 - многоуровневый KV-кэш и почему это важно

Проблема: традиционные KV-кэши масштабируются линейно с историей токенов и быстро исчерпывают VRAM GPU во время длительных сеансов прогнозирования.

Решение МОДЕЛЬ 1: размещает горячие пары KV на VRAM GPU, данные средней частоты KV в ОЗУ CPU и исторические данные KV на диске. Эта выгрузка может значительно сократить потребности в памяти GPU, расширить практические контекстные окна за пределы предыдущих жестких ограничений и снизить затраты по сравнению с хранением всего на GPU. Реальные случаи использования включают полный обзор кода репозитория, анализ огромных документов и согласованные многосессионные помощники.

Разреженное декодирование FP8 - интеллект со смешанной точностью

Инсайт: только подмножество токенов сильно влияет на вычисление следующего токена. Быстро оценивая важность токенов, модель вычисляет критические токены с большей точностью, а остальные в FP8.

Результаты: значительно большее покрытие FP8, почти удваивающее пропускную способность прогнозирования при минимальной потере точности - основной рычаг снижения затрат для услуг с высоким объемом.

Модуль памяти Engram - за пределами окон контекста

Контекст против памяти: V4 отделяет эфемерный рабочий контекст от курируемых долгосрочных воспоминаний, хранящихся в векторной базе данных.

Как это помогает: вместо повторной обработки всей истории, системы извлекают и хранят важные факты, а затем извлекают только то, что актуально - позволяя постоянным помощникам запоминать предпочтения, проектные решения и предыдущие разрешения.

Оптимизированные остатки mHC - более умная динамика обучения

Что изменяется: резервные соединения получают изучаемые коэффициенты масштабирования для каждого слоя, чтобы сеть могла подчеркивать или уменьшать вклад слоя.

Преимущества: быстрее обучение, более плавная сходимость и измеримое повышение качества при меньших затратах на вычисления.

Часть 3. Когда выйдет DeepSeek V4?

Ранние сигналы и отчеты предполагают, что DeepSeek планирует объявление V4 в первую неделю марта 2026 года, с несколькими источниками и обсуждениями в сообществе, указывающими на окно выпуска в ту же неделю, что и Фестиваль фонарей, 3 марта 2026 года. Остается неопределенность до официального заявления, поэтому наблюдатели ожидают объявления или поэтапного выпуска в любой день в течение этого окна.

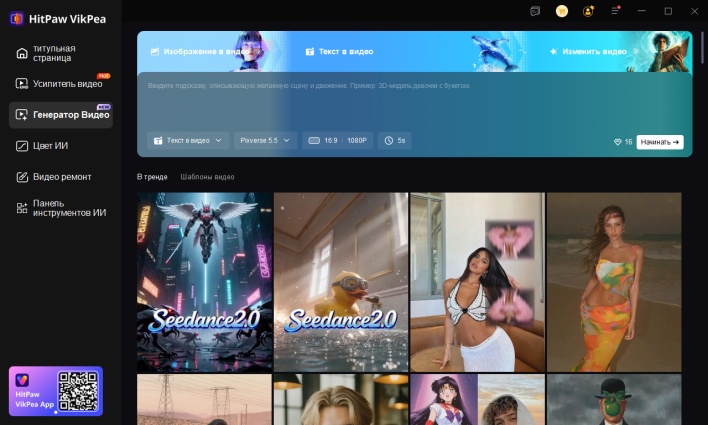

Бонусные советы. Создайте потрясающие AI-видео с помощью генератора видео HitPaw VikPea AI

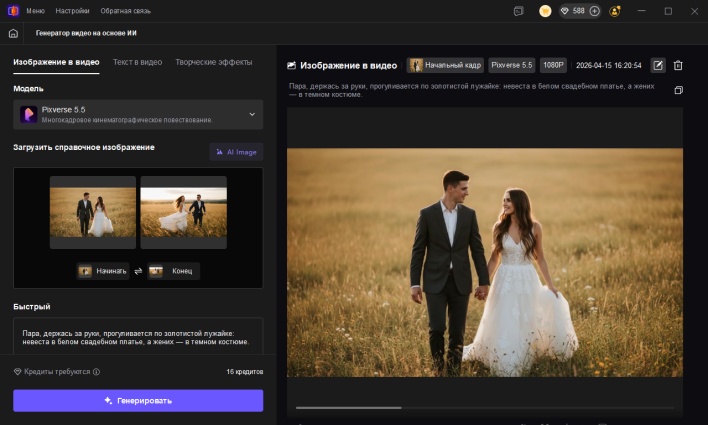

Если вы хотите практический, удобный для настольных компьютеров способ протестировать современные генеративные рабочие процессы, ожидая новостей о модели, HitPaw VikPea предлагает генерацию видео из текста и изображения в видео, а также мощные инструменты для улучшения. VikPea сочетает в себе несколько творческих моделей, простые предустановленные управления и улучшение на уровне кадров, чтобы создатели могли создавать короткие клипы, превращать изображения в движение или полировать отснятый материал перед публикацией. Это прагматичный выбор для создателей, которым нужны быстрые, высококачественные визуальные результаты без глубоких знаний в области машинного обучения.

- Генерация AI-видео из текста или изображений для быстрой креативной видеопроизводства.

- Множественные AI-модели, оптимизированные для различных стилей и эстетических направлений.

- Настраиваемые параметры разрешения и длительности для управления конечной длиной и размером видео.

- Встроенный конвейер улучшения повышает четкость, цвет, резкость и снижение шума.

- Интуитивно понятный интерфейс, разработанный для быстрого получения результатов без технической экспертизы.

- Пакетная обработка и поддержка форматов для профессиональных рабочих процессов и больших файлов.

Шаг 1.Установите и откройте VikPea на Windows или Mac, затем выберите инструмент AI Video Generator из главного меню.

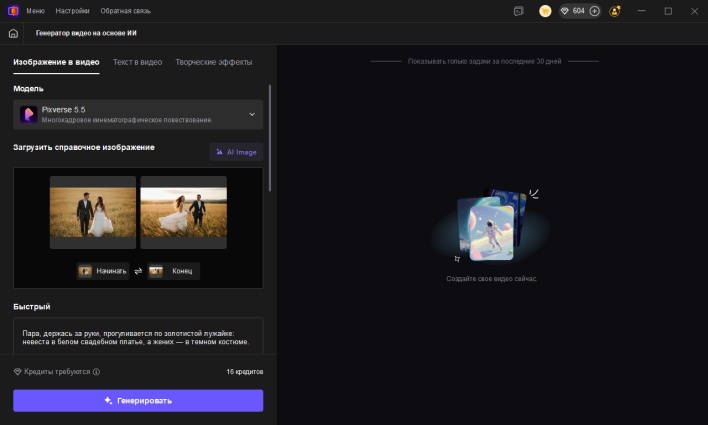

Шаг 2.Введите текстовый запрос или загрузите изображения: выберите Text-to-Video для клипов, основанных на запросах, или Image-to-Video для покадрового движения.

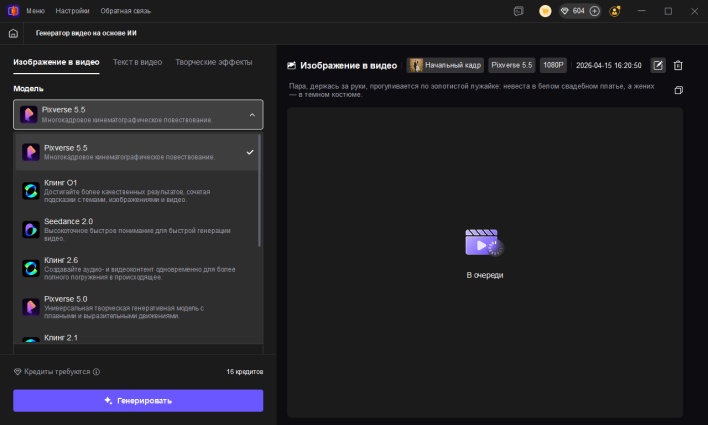

Шаг 3.Выберите модель и настройте параметры вывода, такие как длительность, разрешение и управление стилем.

Шаг 4.Нажмите "Создать", просмотрите результат, затем сохраните или запустите встроенный инструмент улучшения для финальной полировки.

Часть 5. Часто задаваемые вопросы о DeepSeek V4

Ранние утечки и бенчмарки предполагают, что V4 оптимизирован для кодирования и долгосрочного анализа репозиториев, но до публикации независимых, рецензируемых сравнений, преждевременно называть его окончательно лучшей моделью для кодирования. Ожидайте значительных улучшений в анализе кодовых баз, хотя истинная "лучше всего" зависит от задачи, задержки и компромиссов в области безопасности.

Темы на Reddit сочетают в себе агрегацию утечек, тесты разработчиков и ажиотаж сообщества, пока читатели анализируют различия в коде, ссылки МОДЕЛЬ 1 и пробные запуски. Смесь надежных сигналов из репозиториев и спекуляций подпитывает высокий интерес к обсуждениям.

Обновите цепочки инструментов для поддержки выгрузки в оперативную память, исследуйте шаблоны векторной памяти, протестируйте прогнозирование со смешанной точностью и планируйте оценочные наборы для задач с длинным контекстом. Также убедитесь, что процессы проверки управления и безопасности готовы к новым возможностям.

Заключение

DeepSeek V4 выглядит как ключевой инженерный выпуск, который приоритизирует практический масштаб: гораздо более длинные контексты, более дешевое прогнозирование и постоянные воспоминания, которые позволяют агентам действовать больше как товарищи по команде, чем как эфемерные инструменты. Хотя окончательная проверка ожидает официального выпуска и независимых бенчмарков, архитектурные идеи - многоуровневое распределение МОДЕЛЬ 1, разреженное декодирование FP8, память Engram и остатки mHC - являются конкретными рычагами для создания долгосрочного, персонализированного ИИ, полезного и доступного. Следите за окном официального объявления и проведите ранние интеграционные тесты с инструментами, такими как HitPaw VikPea, если вы хотите поэкспериментировать с мультимодальными творческими рабочими процессами уже сегодня.

Оставить комментарий

Напишите свой отзыв о статьях HitPaw